Authenticité & Détection d'IA

Technologie de suivi des images

16 octobre 2023

Les prochaines élections européennes et américaines de 2024 sous l'empire des Deep Fakes

⇥ QUICK READ

<div class="hs-cta-embed hs-cta-simple-placeholder hs-cta-embed-127250935564"

style="max-width:100%; max-height:100%; width:170px;height:300px" data-hubspot-wrapper-cta-id="127250935564">

<a href="https://cta-service-cms2.hubspot.com/web-interactives/public/v1/track/redirect?encryptedPayload=AVxigLJG780n6Gaolzn4nkLXvLqaNiOKQAS72pJmbhN8fC5Aq44UUD0dQi4o9fu7ONSZ%2BwIJsrkynW2EDbHmJ1htI29sSbu8u8ZvdshcQpO%2B3viDhNfADrXbIp8lr0e3FMWrpcZoEldZRHQmQ0TcQgGw7CEOOQ0vS%2F4BPEm3Fpk41btn3lEEcjFx%2B4bwyIBSK8mlgCbUpmymJniHIimIfygj%2FlGXXQ20hkXs36taT4dgZy%2FdgwF%2B7284D6Gz91WerfzGQcUNTMPBXL58Jw%3D%3D&webInteractiveContentId=127250935564&portalId=4144962" target="_blank" rel="noopener" crossorigin="anonymous">

<img alt="EXCLUSIVE REPORT 150 executives share their views about Visual Asset Leaks in their business" loading="lazy" src="https://no-cache.hubspot.com/cta/default/4144962/interactive-127250935564.png" style="height: 100%; width: 100%; object-fit: fill"

onerror="this.style.display='none'" />

</a>

</div>

Partager cet article

S'abonner au blog !

Je m'abonneL'irruption des contenus générés par l'IA permet au phénomène de la désinformation d'entrer dans un nouveau domaine, permettant la création et la diffusion de fausses nouvelles multimédias à une échelle, une vitesse et un niveau de réalisme sans précédent. Les prochaines élections européennes et américaines de 2024 seront les premières élections démocratiques majeures à se dérouler sous l'empire des "deep fakes" alimentés par l'IA. Le Digital Services Act (DSA), le Code de bonnes pratiques de l'UE et le recours à des tiers de confiance authentifiant la provenance des contenus sont les outils dont dispose l'UE et les plateformes.

Ce combat est d'autant plus difficile à mener que la désinformation n'est pas fondamentalement illégale. Il est essentiel de trouver un équilibre délicat entre la sauvegarde de la liberté d'expression et la mise en œuvre de mesures efficaces pour freiner la propagation et l'impact de la désinformation. Il convient donc d'adopter une approche judicieuse qui respecte les valeurs démocratiques tout en atténuant les effets néfastes des fausses informations.

Les institutions de l'UE sont pleinement conscientes des risques liés à la désinformation et tentent de s'attaquer au phénomène dans le cadre d'une approche globale.

Les quatre angles d'attaque de la loi sur les services numériques contre la désinformation

Le 25 août 2023, le Digital Services Act (" DSA ") est entré en vigueur pour les très grandes plateformes en ligne (Facebook, Instagram, Pinterest, Snapchat, TikTok, X...) et les très grands moteurs de recherche en ligne (Google search, Bing).

Le DSA vise à lutter contre la désinformation sous quatre angles principaux pour les plateformes en ligne :

- la suppression plus rapide des "fake news" manifestement illégales,

- une visibilité réduite dans les systèmes de recommandation pour les fausses nouvelles qui ne sont pas considérées comme illégales,

- des mesures d'atténuation, après analyse de leurs risques systémiques, pour lutter contre la propagation de la désinformation et l'utilisation inauthentique de leurs services et de leurs produits.

- des protocoles spécifiques pour lutter contre les contenus susceptibles d'avoir un impact négatif réel ou prévisible sur la sécurité publique et les processus démocratiques/électoraux, et des mesures spécifiques renforcées en cas de crise, comme les conflits armés existants ou nouveaux, les actes de terrorisme, les catastrophes naturelles et les pandémies.

Les outils requis par le code de bonnes pratiques de l'UE en matière de désinformation

Outre le DSA, le code de bonnes pratiques de l'UE en matière de désinformation ("le code") est un outil unique en son genre grâce auquel les acteurs concernés du secteur se sont mis d'accord - pour la première fois en 2018 - sur des normes d'autorégulation pour lutter contre la désinformation.

Le code révisé signé le 16 juin 2022 fera partie d'un cadre réglementaire plus large en combinaison avec l'ASD. Pour les signataires - les très grandes plateformes en ligne et les moteurs de recherche - le code vise à devenir une mesure d'atténuation reconnue dans le cadre de la corégulation du DSA.

Le code contient 44 engagements et 128 mesures spécifiques.

L'engagement 20 stipule ce qui suit : "Les signataires concernés s'engagent à fournir aux utilisateurs des outils permettant d'évaluer la provenance et l'historique d'édition, l'authenticité ou l'exactitude du contenu numérique. Les signataires concernés développeront des solutions technologiques pour aider les utilisateurs à à vérifier l'authenticité ou à identifier la provenance ou la source du contenu numériqueLes signataires concernés développeront des solutions technologiques pour aider les utilisateurs à vérifier l'authenticité ou à identifier la provenance ou la source du contenu numérique, comme de nouveaux outils ou protocoles ou de nouvelles normes techniques ouvertes pour la provenance du contenu."

L'engagement 22 précise : "Les signataires concernés s'engagent à fournir aux utilisateurs des outils pour les aider à prendre des décisions plus éclairées lorsqu'ils rencontrent des informations en ligne qui peuvent être fausses ou trompeuses, et à à faciliter l'accès des utilisateurs aux outils et aux informations permettant d'évaluer la fiabilité des sources d'information, tels que les indicateurs de fiabilité pour une navigation en ligne éclairée, notamment en ce qui concerne les questions de société ou les débats d'intérêt général. Les signataires concernés permettront aux utilisateurs de leurs services d'accéder à des indicateurs de fiabilité (tels que les marques de confiance axées sur l'intégrité de la source et la méthodologie qui sous-tend ces indicateurs) élaborés par des tiers indépendants, en collaboration avec les médias d'information, y compris les associations de journalistes et les organisations de défense de la liberté des médiasainsi que des vérificateurs de faits et d'autres entités concernées, qui peuvent aider les utilisateurs à faire des choix éclairés. Les signataires concernés donneront aux utilisateurs la possibilité de d'intégrer des signaux relatifs à la fiabilité des sources médiatiques dans les systèmes de recommandation ou d'intégrer ces signaux dans leurs systèmes de recommandation. de tels signaux dans leurs systèmes de recommandation."

En résumé, pour endiguer le phénomène de la désinformation, il est nécessaire de mettre à la disposition des utilisateurs des outils transparents permettant d'évaluer la fiabilité des informations et de détecter et d'accroître la visibilité des contenus réels émanant de sources fiables à l'aide d'outils capables de garantir l'exactitude, l'intégrité et la fiabilité de leur provenance.

S'il semble essentiel d'identifier les contenus générés par l'IA pour aider les utilisateurs à s'orienter, il convient d'accorder autant d'importance à l'identification des contenus authentiques provenant de sources vérifiées et fiables, comme les contenus d'actualité provenant d'agences de presse, de médias ou d'autres sources faisant autorité.

La Commission européenne a recommandé l'utilisation d'outils fournis par des tiers indépendants, mais selon le Centre de Transparence, ces engagements sont généralement indiqués comme "non souscrits" ou limités par des initiatives de vérification des faits par les signataires du Code.

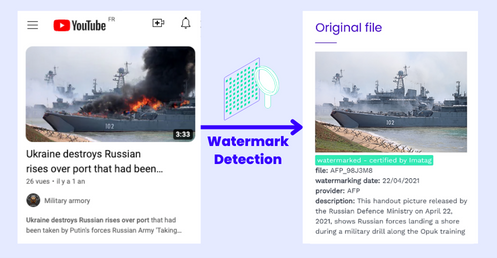

En quoi le filigrane invisible d'un tiers indépendant permettra-t-il de résoudre véritablement le problème ?

La meilleure façon de certifier techniquement un contenu est de le doter d'un filigrane invisible directement à la source (cf. "Google DeepMind's SynthID and the Imperative of Comprehensive Watermarking"). Cette technologie existe depuis de nombreuses années, mais a récemment connu des améliorations notables(DeepMind partners with Google Cloud to watermark AI-generated images | TechCrunch ). Selon OpenAI et Google, un filigrane robuste est la meilleure solution pour certifier un contenu visuel. Le mois dernier, Google a lancé son propre système de filigrane appelé SynthID. Cependant, une limitation importante est évidente : SynthID identifiera exclusivement le contenu généré par l'IA de Google, produit par exemple par Imagen, et uniquement au sein de l'écosystème de Google.

Cette limitation n'existe pas lorsqu'on utilise un tiers indépendant capable de générer un filigrane pour des contenus réels provenant de sources vérifiées, une technologie qui pourrait potentiellement être adoptée par toutes les plateformes en ligne.

L'apposition d'un filigrane robuste et invisible sur les contenus authentiques provenant de sources fiables présente de multiples avantages, tant pour le public que pour les plateformes en ligne :

Rétablir la confiance entre les utilisateurs et les plateformes en ligne

Tout d'abord, il est possible de rétablir la confiance entre les utilisateurs et les plateformes en ligne en étiquetant les contenus réels provenant de sources fiables, en plus de l'étiquetage des contenus générés par l'IA, et en fournissant aux utilisateurs des outils de réflexion critique. Les utilisateurs pourraient immédiatement visualiser s'il s'agit d'un contenu généré par l'IA, d'un contenu réel, d'un contenu réel manipulé ou faussement attribué, ou d'un contenu non identifié.

Deuxièmement, la possibilité de visualiser le contenu authentique, les métadonnées associées et le contexte d'origine constituerait un avantage majeur pour les utilisateurs et les plateformes en ligne. Les uns et les autres pourraient immédiatement identifier les manipulations ou les fausses attributions. Cela ouvrirait la voie à une suppression immédiate par les plateformes en ligne en cas d'illégalité manifeste ou à une réduction de la visibilité dans les systèmes de recommandation si l'on considère qu'il s'agit de fausses nouvelles "non illégales".

Un autre avantage pour les très grandes plateformes en ligne et les moteurs de recherche serait d'améliorer les mesures d'atténuation requises par le DSA concernant la diffusion de la désinformation et, en même temps, d'aider à développer de nouvelles stratégies pour lutter contre la désinformation pendant les crises politiques et économiques. Les récentes élections en Slovaquie ont démontré le manque d'efficacité des outils de lutte contre les fausses nouvelles déployés par certaines plateformes en ligne.

La lutte contre l'Infocalypse

Infocalypse signifie généralement l'imminence d'une surcharge de fausses informations.

Le 26 septembre 2023, les principales plateformes en ligne ont rendu compte des six premiers mois d'application du nouveau code de bonnes pratiques en matière de désinformation.

Selon la commissaire Jourova : "La désinformation reste l'un des plus grands risques pour l'espace démocratique européen de l'information, y compris celui lié à la guerre de la Russie en Ukraine et aux élections. Alors que les Européens s'apprêtent à se rendre dans les bureaux de vote en 2024, tous les acteurs doivent jouer leur rôle dans la lutte contre la désinformation en ligne et l'ingérence étrangère afin de protéger notre débat en ligne. Le code s'avère être un exercice utile, mais nous devons tous en faire plus"

La prochaine série de rapports est prévue pour le début de l'année 2024 (avec des informations et des données couvrant le second semestre de 2023) et devrait fournir des indications supplémentaires sur la mise en œuvre du Code. Ces rapports contiendront également des informations sur la manière dont les signataires se préparent et mettent en place des mesures visant à réduire la propagation de la désinformation avant les élections européennes et américaines de 2024, tout en continuant à rendre compte de leurs efforts dans le contexte de la guerre en Ukraine, à laquelle nous pouvons déjà ajouter la guerre en Israël.

Il s'agit d'un appel à la labellisation des contenus réels provenant de sources fiables au moyen d'un filigrane numérique. Si cette mesure est adoptée par les principales plateformes en ligne dans un avenir proche, un ou plusieurs des quatre cavaliers de l'Infocalypse pourraient tomber de leur cheval.

Vous voulez "voir" un filigrane invisible ?

Découvrez la solution IMATAG pour insérer des filigranes invisibles dans vos contenus visuels.

Réserver une démoCes articles peuvent également vous intéresser

.png)

Authenticité & Détection d'IA

9 avril 2024

Loi européenne sur l'IA : Étiquetage obligatoire des contenus générés par l'IA

Authenticité & Détection d'IA

5 mars 2024

Marquage numérique embarqué : garantir l'authenticité d'une image dès sa capture.

Authenticité & Détection d'IA

14 mars 2024